日志管理实践:项目复盘与经验提炼

在软件开发的生命周期中,日志是系统的“黑匣子”,它记录了应用运行时的每一个关键动作、异常状态和性能指标。然而,许多团队在项目初期往往只关注功能实现,对日志管理采取“能用就行”的临时策略,导致在项目后期或线上问题排查时陷入“日志海洋”或“无日志可查”的困境。本文旨在通过一次真实的项目复盘,系统性地总结日志管理的核心实践,并穿插探讨相关的开源项目推荐、移动开发趋势对日志的影响,以及提升效率的代码编辑器配置技巧。

一、 从混乱到有序:日志管理体系的构建

在我们复盘的项目中,初期日志使用非常随意:控制台打印(System.out.println)、print语句散落各处,格式不统一,且缺乏关键上下文(如用户ID、请求ID)。当第一个线上故障发生时,我们花了数小时才从杂乱的文本文件中拼凑出问题线索。

核心经验提炼:

- 统一日志框架: 立即引入成熟的日志门面(如SLF4J)和实现(如Logback、Log4j2)。这解决了API统一和灵活配置的问题。

- 定义日志级别规范: 明确

ERROR、WARN、INFO、DEBUG、TRACE的使用场景。例如,ERROR必须伴随异常堆栈;业务流程关键节点用INFO;循环内部详细数据用DEBUG。 - 结构化日志: 告别纯文本,采用JSON等结构化格式输出。这为后续的日志采集和分析(如使用ELK栈)奠定了坚实基础。

一个改进后的Logback JSON配置示例如下:

<appender name="JSON" class="ch.qos.logback.core.ConsoleAppender">

<encoder class="net.logstash.logback.encoder.LogstashEncoder">

<customFields>{"appname":"my-service","env":"${ENV}"}</customFields>

</encoder>

</appender>

这会将日志输出为:{"@timestamp":"...", "level":"INFO", "message":"User login success", "user_id":"123", "appname":"my-service", ...},极大方便了机器解析。

二、 开源利器推荐:提升日志处理效率

构建好基础规范后,利用优秀的开源工具可以事半功倍。以下是我们在项目中验证并推荐的组合:

- 采集与解析:Filebeat / Fluentd:轻量级的日志文件采集器,负责将服务器上的日志文件实时发送到中心化的日志系统。

- 传输与缓冲:Kafka:在高流量场景下,作为日志管道,起到削峰填谷和解耦的作用,防止日志洪峰冲垮存储系统。

- 存储与搜索:Elasticsearch:无需多言,是存储和索引日志数据的首选,其强大的全文检索和聚合能力是问题排查的利器。

- 可视化与分析:Kibana / Grafana:Kibana与ELK栈天然集成,用于日志查询和简单看板;Grafana则在监控指标可视化上更强大,可与ES数据源结合制作业务监控大盘。

- 高级查询:Sentry / Loki:Sentry专注于应用错误(Exception)的聚合和告警;Grafana Loki则受Prometheus启发,使用标签索引日志,适合云原生环境,查询语法强大且资源消耗低。

结合移动开发趋势,现代跨平台框架(如Flutter、React Native)和原生开发都强调端到端的可观测性。我们推荐在移动端集成像Sentry这样的SDK,它不仅捕获崩溃,还能记录用户操作流(Breadcrumbs),将移动端日志与后端服务日志通过统一的Request ID关联,实现全链路追踪。

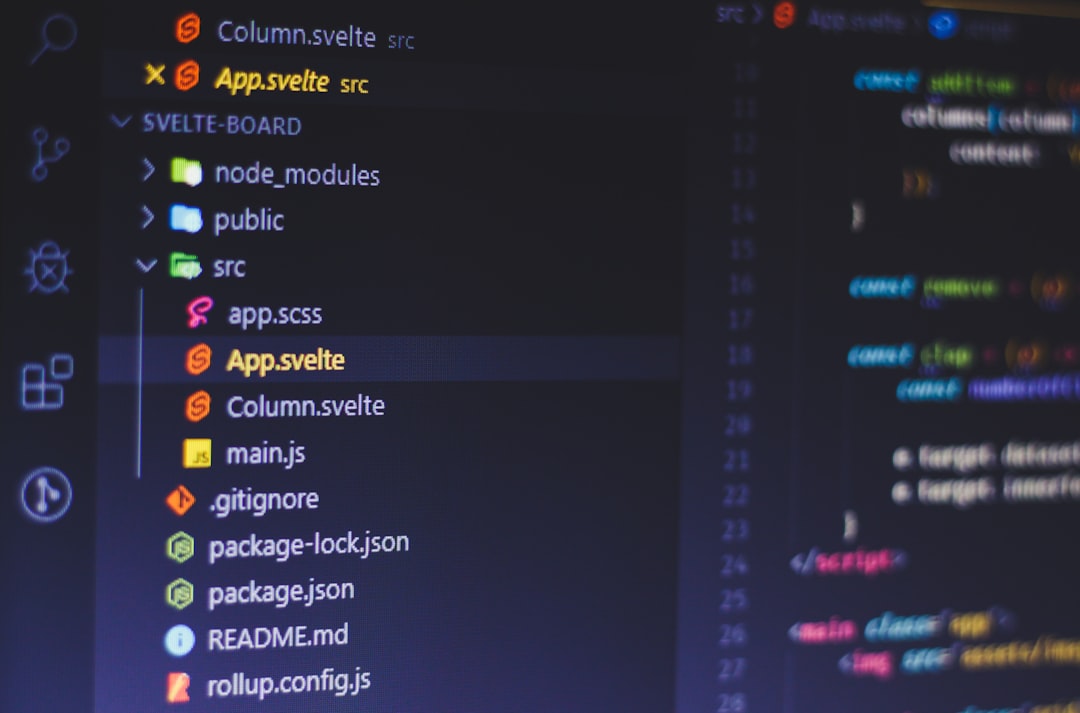

三、 开发侧优化:编辑器配置与日志代码规范

高效的日志管理也需要从编码源头抓起。合理的代码编辑器配置和团队规范能减少错误、提升可读性。

1. 编辑器/IDE配置技巧:

- 日志模板(Live Templates): 在IntelliJ IDEA或VS Code中配置日志代码片段。例如,输入

logi+Tab自动生成带当前类名的LOG.info(...)语句。 - 日志高亮: 安装插件(如Grep Console for IDEA)对不同级别的日志进行颜色高亮,在本地调试时快速识别错误和警告。

- 结构化日志预览: 对于输出到控制台的JSON日志,使用插件(如VS Code的“JSON Logs”)进行自动格式化和高亮,一目了然。

2. 日志代码编写“军规”:

- 避免字符串拼接: 使用日志框架的参数化语法,如

LOG.info("User {} logged in from {}", userId, ipAddress);。这能提升性能(惰性求值)并避免不必要的toString()调用。 - 谨慎记录敏感信息: 通过编写自定义的

Converter或使用@ToString.Exclude(Lombok)等方式,自动脱敏密码、身份证号、令牌等数据。 - 赋予日志上下文: 在Web请求入口处,将唯一的

Trace ID放入MDC(Mapped Diagnostic Context),这样在该请求链路中的所有日志都会自动带上此ID。

// 示例:使用SLF4J的MDC

import org.slf4j.MDC;

public void handleRequest(Request req) {

String traceId = generateTraceId();

MDC.put("traceId", traceId);

try {

LOG.info("Request started.");

// ... 业务逻辑

} finally {

MDC.clear(); // 务必清理,防止内存泄漏

}

}

四、 面向运维与业务:从日志到洞察

日志的终极价值不止于排错,更在于转化为业务和运维的洞察力。

运维监控: 通过日志实时计算错误率(如5分钟内ERROR日志数量/总日志量),并配置告警规则(如错误率>1%时触发PagerDuty通知)。在Grafana中,一个简单的PromQL查询即可实现:

rate(log_entries_total{level="error"}[5m]) / rate(log_entries_total[5m])

业务分析: 在关键业务节点(如“订单支付成功”、“内容发布”)记录结构化的业务日志。这些日志进入数据湖(如通过Kafka导入Hive或ClickHouse)后,可以替代部分打点数据,用于分析用户行为漏斗、功能使用频率等,成本更低且上下文更丰富。

这要求开发、运维和业务团队在日志规范制定初期就进行协作,共同定义哪些是关键业务事件及其记录字段。

五、 持续改进:日志治理与成本控制

随着系统规模扩大,日志量会爆炸式增长,带来巨大的存储和计算成本。我们曾因一个错误的DEBUG日志配置,导致单日日志量激增10倍。

治理策略:

- 采样: 对

INFO等低级别日志进行采样(如10%),保留全部ERROR日志。Logback和Log4j2都支持复杂的采样配置。 - 分级存储与生命周期: 定义日志保留策略。例如,最近3天的日志保存在ES热节点供快速查询;3天至30天的日志转存至对象存储(如S3)温层;超过30天的压缩归档。

- 定期审计: 每季度回顾日志配置和内容,检查是否有无用的日志输出、敏感信息泄露,以及日志格式是否仍符合新的分析需求。

总结

有效的日志管理是一个贯穿项目始终的系统性工程,而非事后的补救措施。它始于开发时统一的框架与规范,得益于强大的开源项目(如ELK、Loki、Sentry)构建的管道,并通过合理的代码编辑器配置和团队纪律在源头保障质量。同时,我们需要关注移动开发趋势带来的端上日志挑战,实现前后端一体化的可观测性。最终,让日志从被动的“记录者”转变为主动的“洞察者”,驱动运维的稳定和业务的增长。记住,你今天精心记录的一条日志,可能就是未来拯救一次线上危机的关键线索。