大数据在企业中的应用价值:专家观点与深度思考

在数字经济时代,数据已成为与土地、劳动力、资本、技术并列的新型生产要素。企业每天产生的海量数据,不再是IT系统的“副产品”,而是驱动业务增长、优化运营效率和重塑商业模式的“新石油”。然而,从原始数据到商业价值,这条转化之路充满挑战。本文将从技术专家视角,深入剖析大数据在企业中的核心应用价值,并结合部署工具的演进与2025年技术趋势,为企业数据战略提供深度思考与实践指引。

一、 从成本中心到价值引擎:大数据应用的三大核心价值

企业部署大数据平台,其根本目的在于将数据转化为可行动的洞见,进而创造商业价值。专家普遍认为,其核心价值体现在以下三个维度:

1. 驱动智能决策,从“经验主义”到“数据驱动”

传统决策往往依赖管理者的个人经验和直觉,存在主观性和滞后性。大数据分析通过整合内外部多源数据(如交易记录、用户行为、市场舆情、物联网传感器数据),构建预测模型和实时看板,使决策过程变得可量化、可预测、可追溯。

- 精准营销: 通过用户画像和实时行为分析,实现千人千面的产品推荐和个性化营销,显著提升转化率和客户生命周期价值。

- 供应链优化: 利用历史销售数据、天气数据、交通数据预测需求,动态调整库存和物流路线,实现降本增效。

- 风险控制: 在金融领域,通过分析交易模式、社交网络等数据,实时识别欺诈行为与信用风险。

2. 重塑产品与服务,实现创新与差异化

数据不仅用于优化现有业务,更能催生全新的产品和服务模式。

- 产品智能化: 智能硬件(如智能家居、工业设备)通过收集使用数据,实现远程诊断、预测性维护和功能迭代。

- 数据即服务(DaaS): 企业可将脱敏、聚合后的行业洞察数据,作为增值服务提供给客户或合作伙伴,开辟新的收入渠道。

- 用户体验闭环: 通过持续收集和分析用户反馈与使用数据,快速迭代产品功能,构建以用户为中心的产品开发流程。

3. 提升运营效率,实现自动化与流程再造

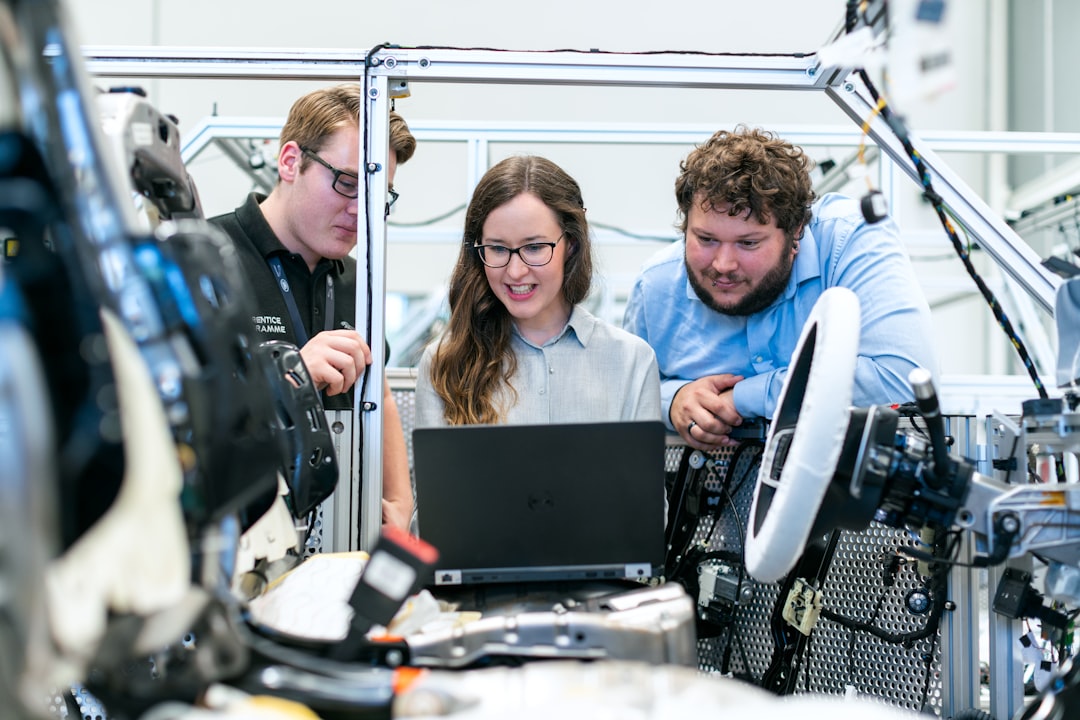

大数据与人工智能结合,正在深度改变企业内部运营流程。

- 预测性维护: 在制造业,通过分析设备传感器数据,预测故障发生概率,变“定期检修”为“按需维护”,大幅减少停机时间。

- 智能客服: 利用自然语言处理(NLP)分析海量客服对话,自动生成知识库、识别用户情绪,并驱动聊天机器人解决大部分常见问题。

- 人力资源优化: 分析员工绩效、技能、项目参与等数据,辅助人才盘点、预测离职风险并规划个性化发展路径。

二、 基石与加速器:现代化部署工具的关键角色

大数据价值的实现,离不开稳定、高效、易用的技术基础设施。近年来,部署工具的演进极大地降低了大数据平台的管理复杂度,提升了开发运维效率,成为释放数据价值的关键加速器。

1. 容器化与编排:标准化部署环境

以Docker为代表的容器技术,将应用及其所有依赖打包成一个标准化的单元,确保了从开发到测试、生产环境的一致性。而Kubernetes(K8s)作为容器编排的事实标准,则解决了大规模容器集群的部署、伸缩、管理和服务发现难题。

专家观点: 对于大数据组件(如Spark、Flink、Kafka),容器化部署已成为主流。它允许企业快速搭建、复制和销毁复杂的数据处理集群,实现资源的弹性利用。

# 一个简化的Kubernetes部署Spark Master的YAML片段示例

apiVersion: apps/v1

kind: Deployment

metadata:

name: spark-master

spec:

replicas: 1

selector:

matchLabels:

component: spark-master

template:

metadata:

labels:

component: spark-master

spec:

containers:

- name: spark-master

image: bitnami/spark:3.3

command: ["/opt/bitnami/scripts/spark/run.sh"]

args: ["--class", "org.apache.spark.deploy.master.Master"]

ports:

- containerPort: 7077

name: spark

- containerPort: 8080

name: http-webui2. 基础设施即代码(IaC)与GitOps:实现可重复与可审计的部署

使用Terraform、Ansible等工具,通过代码定义和配置服务器、网络、存储等基础设施。结合Git版本控制系统,所有基础设施和应用的变更都通过Pull Request进行,实现部署流程的自动化、可追溯和可回滚。

实践价值: 这使得大数据平台的部署像管理软件代码一样简单,极大地减少了人为错误,加快了新环境的搭建速度,并完美符合合规审计要求。

3. 云原生与Serverless架构:聚焦业务逻辑

云服务商(AWS, Azure, GCP)提供了全托管的大数据服务(如AWS EMR、Azure Databricks、BigQuery)。更进一步,Serverless数据处理服务(如AWS Lambda、Google Cloud Dataflow)允许开发者只编写业务逻辑代码,无需关心服务器配置、集群扩缩容等底层运维问题。

深度思考: 这标志着部署工具的终极方向——让数据工程师和科学家完全从基础设施的繁重管理中解放出来,将全部精力投入到数据价值挖掘本身。

三、 前瞻2025:塑造未来的大数据技术趋势

站在当前节点展望,到2025年,以下几个技术趋势将深刻影响企业大数据应用的格局与深度。

1. 湖仓一体(Lakehouse)成为数据架构新范式

传统的数据湖(灵活存储原始数据)与数据仓库(高性能处理结构化数据)的割裂带来了数据冗余、一致性差、管理复杂等问题。Lakehouse架构(如Databricks Delta Lake、Apache Iceberg、Hudi)试图融合两者优点:在低成本存储(如对象存储S3)上,提供数据仓库般的事务支持、 schema管理、高性能查询和BI优化能力。

专家观点: 到2025年,Lakehouse有望成为企业构建统一数据平台的首选架构,简化数据栈,支持从BI报表到机器学习等所有工作负载。

2. 实时数据处理与“流批一体”常态化

企业对数据时效性的要求越来越高,实时风控、实时推荐、实时监控等场景成为标配。Apache Flink、Spark Structured Streaming等流处理框架日趋成熟。同时,“流批一体”的理念——即用同一套API和计算引擎处理实时流数据和历史批数据——将极大降低开发维护复杂度,成为技术选型的重要考量。

3. 数据治理与隐私计算的强制化

随着全球数据法规(如GDPR、CCPA、中国《数据安全法》)的完善,数据治理从“可选”变为“必选”。自动化的数据血缘追踪、数据质量监控、敏感数据发现与脱敏工具将深度集成到数据平台中。同时,隐私计算技术(如联邦学习、安全多方计算、可信执行环境)将在保障数据“可用不可见”的前提下,实现跨组织的数据价值协作,开辟新的数据应用疆域。

4. AI for DataOps:增强型数据管理

人工智能将深度赋能数据管理的各个环节:

- 智能数据目录: 利用NLP自动为数据资产打标签、生成业务描述。

- 自动化的ETL/ELT: 通过机器学习推荐数据转换规则、自动识别和修复数据质量问题。

- 查询优化与成本管理: AI自动优化数据查询性能,并预测和控制云上数据处理成本。

总结

大数据在企业中的应用,已走过“概念炒作”和“平台建设”的初期阶段,正步入“价值深耕”和“智能融合”的成熟期。其核心价值始终围绕决策智能化、产品创新化、运营高效化展开。而现代化部署工具的普及,特别是容器化、IaC和云原生范式,是规模化、敏捷化释放这一价值的技术基石。

展望2025年技术趋势,Lakehouse、实时计算、强治理与隐私计算、AI增强的数据管理将成为主导力量。对于企业的启示在于:技术决策者不应再孤立地看待大数据组件,而应将其置于一个融合了先进部署理念、统一架构和智能治理的完整蓝图中。最终的成功,将属于那些能够将数据战略与业务战略紧密结合,并利用不断演进的技术工具,构建起持续、安全、高效的数据价值转化体系的企业。