机器学习成功案例与经验分享:赋能招聘与合规安全

在当今数据驱动的时代,机器学习(ML)已从实验室走向产业核心,成为解决复杂业务难题、提升效率与创造价值的利器。它不仅是技术专家的工具,更是企业战略转型的关键驱动力。本文将通过两个紧密相关的领域——智能化招聘与网络安全合规——来分享机器学习的成功应用案例与核心实践经验。这两个领域恰好对应了企业“人”与“法”的关键需求,而机器学习在其中扮演了至关重要的角色。

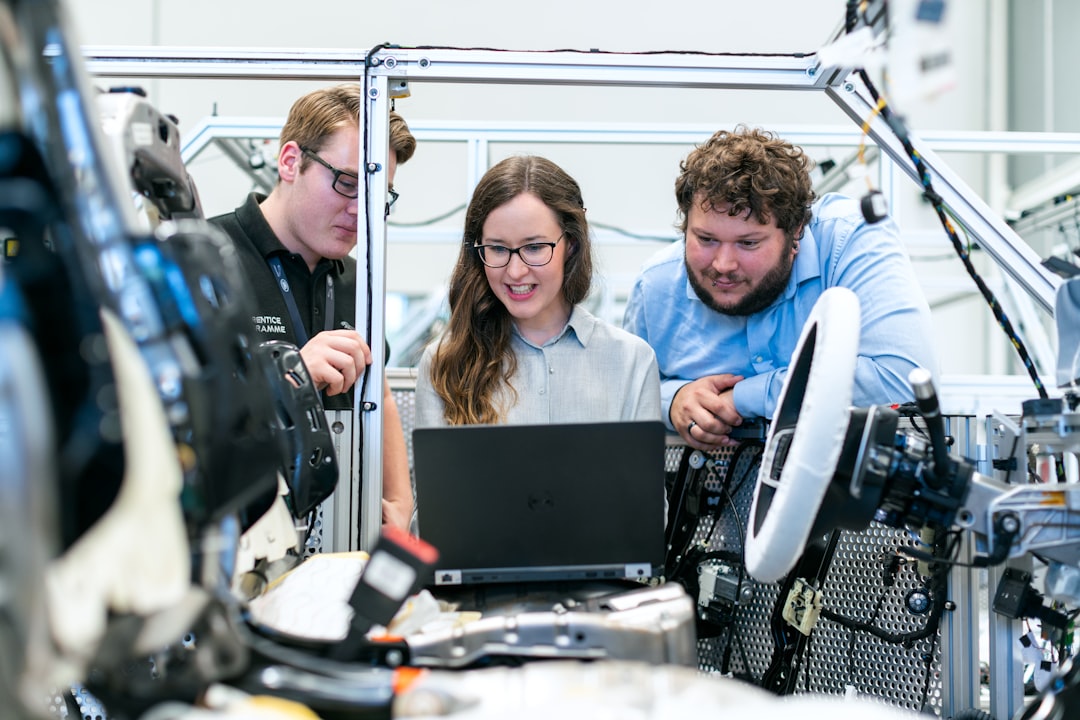

一、 智能化招聘:从海量信息到精准匹配

传统的招聘流程依赖HR人工筛选简历,耗时耗力且易受主观因素影响,尤其在面对海量招聘信息时,效率瓶颈明显。机器学习通过自然语言处理(NLP)和推荐系统技术,正在彻底改变这一局面。

成功案例:某大型招聘平台的简历智能筛选与匹配系统

该平台每日处理数百万份新增简历和职位描述(JD)。他们的目标是实现求职者与岗位的高精度、自动化匹配。

- 技术实现:

- 文本向量化: 使用如BERT、Word2Vec等模型,将简历中的技能、经验、项目描述,以及JD中的职位要求、职责等非结构化文本,转化为高维度的数值向量。这使得计算机能够“理解”文本的语义。

- 相似度计算: 采用余弦相似度等算法,计算简历向量与职位向量之间的匹配度。一个简化的核心匹配逻辑可以用以下伪代码表示:

# 伪代码示例:核心匹配逻辑

def calculate_match_score(resume_vector, job_vector):

# 计算余弦相似度

cosine_sim = dot(resume_vector, job_vector) / (norm(resume_vector) * norm(job_vector))

# 结合其他权重因素,如工作年限匹配度、地理位置偏好等

experience_score = calculate_experience_score(resume, job)

location_score = calculate_location_score(resume, job)

# 综合得分

total_score = 0.6 * cosine_sim + 0.25 * experience_score + 0.15 * location_score

return total_score

- 模型训练与优化: 利用历史投递和面试成功(如进入二面、最终录用)的数据作为正样本,训练排序学习(Learning to Rank)模型,使系统不仅关注关键词匹配,更能学习到哪些“软性”特征(如项目经历的表述方式、技能的组合)更可能导致成功录用。

经验分享:

- 数据质量是关键: 模型的性能上限取决于数据。必须对简历和JD数据进行彻底的清洗、去重和标准化(例如,将“Java开发”和“JAVA程序员”统一)。

- 警惕算法偏见: 如果历史数据中存在性别、院校等歧视,模型会学习并放大这种偏见。需采用去偏见技术,并在特征工程中谨慎使用敏感属性。

- 人机协同: 系统应作为HR的“超级助手”,提供匹配度排序和关键信息高亮,而非完全取代人工决策。最终面试邀约的决定权应保留在HR手中。

二、 网络安全合规:在《网络安全法》框架下的智能防御

随着《网络安全法》及《数据安全法》、《个人信息保护法》的施行,企业面临前所未有的合规压力。法律要求网络运营者采取技术措施监测、记录网络运行状态和网络安全事件。机器学习成为实现主动、智能安全合规的核心技术。

成功案例:某金融机构的实时异常交易与内部威胁检测系统

为满足合规要求并防范内部风险,该机构部署了基于机器学习的用户与实体行为分析(UEBA)系统。

- 技术实现:

- 基线建模: 系统首先收集每个员工(实体)在正常业务周期内的行为数据,如登录时间、访问的数据类型和数量、交易操作习惯、网络流量模式等。使用无监督学习算法(如孤立森林、自编码器)为每个实体建立“正常行为基线”。

- 异常检测: 实时对比当前行为与基线。当某个员工在非工作时间访问大量敏感客户数据,或某个服务账户的API调用频率出现异常峰值时,系统会计算出一个异常分数。

# 伪代码示例:基于孤立森林的异常检测简化思路

from sklearn.ensemble import IsolationForest

# 假设X_train是历史正常行为特征矩阵

clf = IsolationForest(contamination=0.01, random_state=42) # contamination为预期异常比例

clf.fit(X_train)

# 对新行为数据X_new进行预测

prediction = clf.predict(X_new)

# 输出-1代表异常,1代表正常

if prediction[0] == -1:

alert_security_team("发现潜在内部威胁行为", X_new)

- 关联分析与溯源: 当检测到异常后,系统会利用图算法,将该异常事件与相关的网络日志、数据库访问日志、终端行为日志进行关联分析,快速形成完整的攻击链或违规操作证据链,满足《网络安全法》第二十一条关于“留存相关网络日志不少于六个月”并能够“有效溯源”的要求。

经验分享:

- 合规驱动设计: 系统设计之初就必须将法律要求(如日志留存期限、个人信息脱敏、事件报告时限)作为功能需求融入其中,而非事后补救。

- 平衡误报与漏报: 安全模型需要精细调优。过高的误报会使安全团队疲劳,忽略真实威胁;过低的检测率则会导致合规风险。需要根据业务风险容忍度设定阈值。

- 可解释性至关重要: 当系统告警时,必须能向安全分析师和可能的法律调查人员清晰地解释“为什么这个行为被判定为异常”。使用SHAP、LIME等可解释AI工具至关重要。

三、 跨领域的共同经验与最佳实践

无论是招聘还是风控,成功的机器学习项目都遵循一些通用法则。

- 1. 问题定义优于算法选择: 不要从“我想用深度学习”开始,而要从“我要解决什么业务问题”开始。精准定义问题(如“提高优质简历的初筛通过率”或“降低内部数据泄露风险”)是成功的第一步。

- 2. 构建迭代式MVP(最小可行产品): 快速构建一个包含核心逻辑的简单模型投入试用,收集反馈,持续迭代。例如,先做一个基于关键词和规则的简历筛选器,再逐步引入NLP模型。

- 3. 建立跨职能团队: 项目团队必须包含业务专家(HR、法务、安全官)、数据工程师和机器学习工程师。业务专家提供领域知识和评判标准,是模型能否落地的关键。

- 4. 持续监控与模型更新: 模型上线不是终点。业务环境在变(如新的热门技能、新的攻击手法),数据分布也会漂移。必须建立模型性能的持续监控流水线,定期用新数据重新训练或微调模型。

总结

机器学习在招聘信息处理和网络安全法合规领域的成功应用,清晰地展示了其将数据转化为业务洞察和合规能力的强大力量。在招聘场景,它通过语义理解和智能匹配,提升了人才获取的效率和公平性;在安全合规场景,它通过行为建模和异常检测,帮助企业构建主动、智能的防御体系,满足法律法规的刚性要求。

这些成功并非偶然,它们根植于对业务痛点的深刻理解、对数据质量的严格把控、对算法偏见和可解释性的审慎处理,以及坚持人机协同的务实理念。对于计划引入机器学习的企业而言,从一个小而具体的业务点切入,组建跨职能团队,采用迭代式开发,并始终将解决实际问题和满足合规要求作为核心目标,将是通往成功最可靠的路径。未来,随着多模态学习、联邦学习等技术的发展,机器学习在人与法这两个企业核心维度上的赋能,必将更加深入和智能。