大数据应用市场:机遇与挑战并存

我们正处在一个数据爆炸的时代。从社交媒体互动、物联网传感器到企业交易记录,海量数据正以前所未有的速度生成。大数据应用市场,作为挖掘这些数据潜在价值的核心领域,其规模与重要性正与日俱增。它为企业提供了精准决策、优化运营和创造新商业模式的无限可能。然而,在巨大的机遇背后,数据孤岛、隐私安全、信任缺失和技术复杂性等挑战也如影随形。本文将探讨大数据应用市场的现状,并深入分析区块链技术与新兴编程语言如何成为应对这些挑战、释放数据价值的关键赋能者。

机遇:数据驱动的新商业范式

大数据应用的核心价值在于将原始数据转化为可行动的洞察力。这催生了多个充满机遇的领域。

精准营销与客户洞察

通过分析用户的浏览历史、购买行为和社交数据,企业可以构建精细的用户画像,实现千人千面的产品推荐和个性化营销,极大提升了转化率和客户忠诚度。

预测性分析与智能决策

在金融、供应链和工业制造领域,利用机器学习模型对历史数据进行训练,可以实现风险预测、需求预估和设备故障预警,从被动响应转向主动管理。

数据产品与服务创新

数据本身正在成为一种可交易的产品。例如,地理位置数据服务于城市规划,匿名化的消费数据助力市场研究,催生了全新的数据经济生态。

核心挑战:数据治理与信任之困

尽管前景广阔,但大数据应用的深入发展面临几座必须逾越的大山。

数据孤岛与共享难题

数据往往分散在不同部门、机构甚至竞争对手之间,格式不一、标准各异,形成“数据孤岛”。由于缺乏信任和有效的激励机制,数据所有者不愿或不敢共享数据,导致数据价值无法在更大范围内流通和增值。

隐私安全与合规压力

随着GDPR、CCPA等全球数据保护法规的出台,用户隐私被提到了前所未有的高度。如何在利用数据的同时确保匿名化、获得用户授权并满足合规要求,是每个大数据项目必须解决的难题。

数据质量与溯源缺失

“垃圾进,垃圾出”。数据的准确性、完整性和一致性直接影响分析结果的可信度。此外,数据从产生到分析的整个链条缺乏透明追溯,一旦结果出现问题,难以定位责任环节。

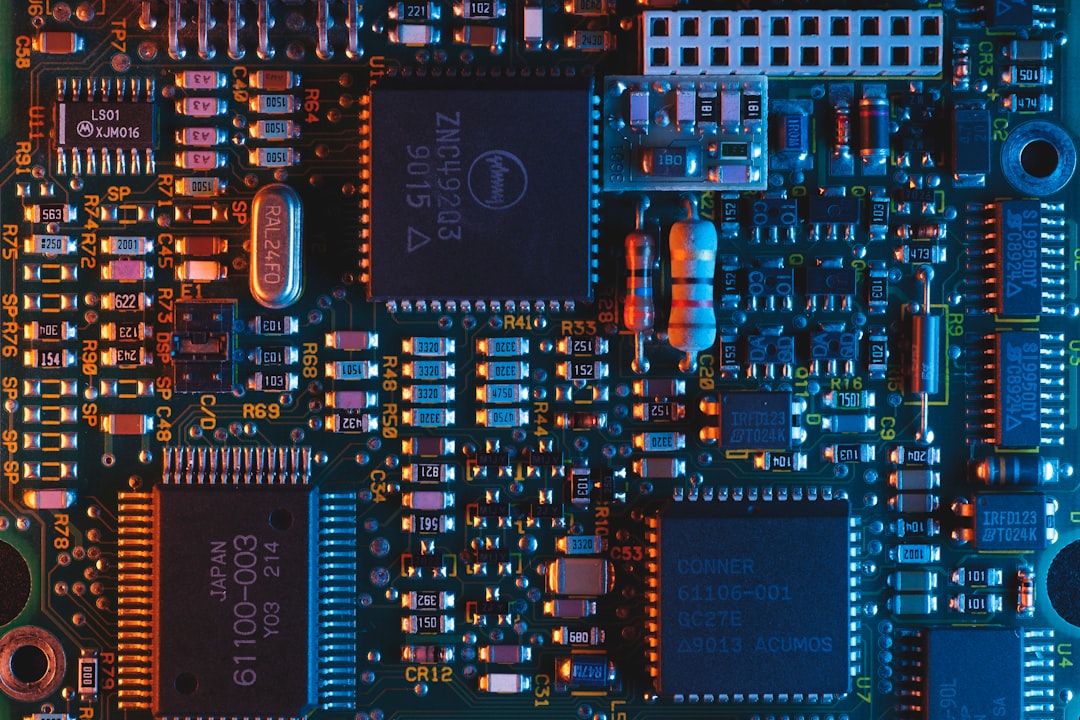

区块链技术:构建可信的数据协作基础设施

区块链技术以其去中心化、不可篡改、可追溯和智能合约自动执行的特性,为上述挑战提供了革命性的解决方案。它本质上是一个分布式的、可信的数据库。

实现安全可控的数据共享

区块链可以作为一个数据访问的“控制层”,而不必存储原始数据本身。通过将数据的哈希指纹(Hash)和访问权限规则上链,数据所有者可以精确控制谁、在何时、以何种条件访问自己的数据。智能合约能自动执行数据使用协议和支付条款,在保护隐私的前提下激活数据流通。

// 一个简化的智能合约示例(Solidity语言),用于管理数据访问权限

contract DataAccessControl {

mapping(address => mapping(string => bool)) private permissions;

mapping(string => address) public dataOwner;

// 数据所有者授权

function grantAccess(address _user, string memory _dataId) public {

require(msg.sender == dataOwner[_dataId], "Not owner");

permissions[_user][_dataId] = true;

}

// 验证用户是否有权访问特定数据

function canAccess(address _user, string memory _dataId) public view returns (bool) {

return permissions[_user][_dataId];

}

}保障数据完整性与溯源

任何对数据集的修改或分析步骤都可以将其哈希值记录在区块链上,形成不可篡改的审计线索。这确保了数据在流转和分析过程中的完整性,任何篡改都会被轻易发现,极大地增强了数据分析结果的可信度。

隐私计算结合:数据“可用不可见”

区块链与安全多方计算(MPC)、零知识证明(ZKP)等隐私计算技术结合,可以实现更高级别的隐私保护。例如,多个医院可以在不共享原始病历数据的情况下,共同训练一个疾病预测模型,真正做到了数据的“价值流通而原始数据不流通”。

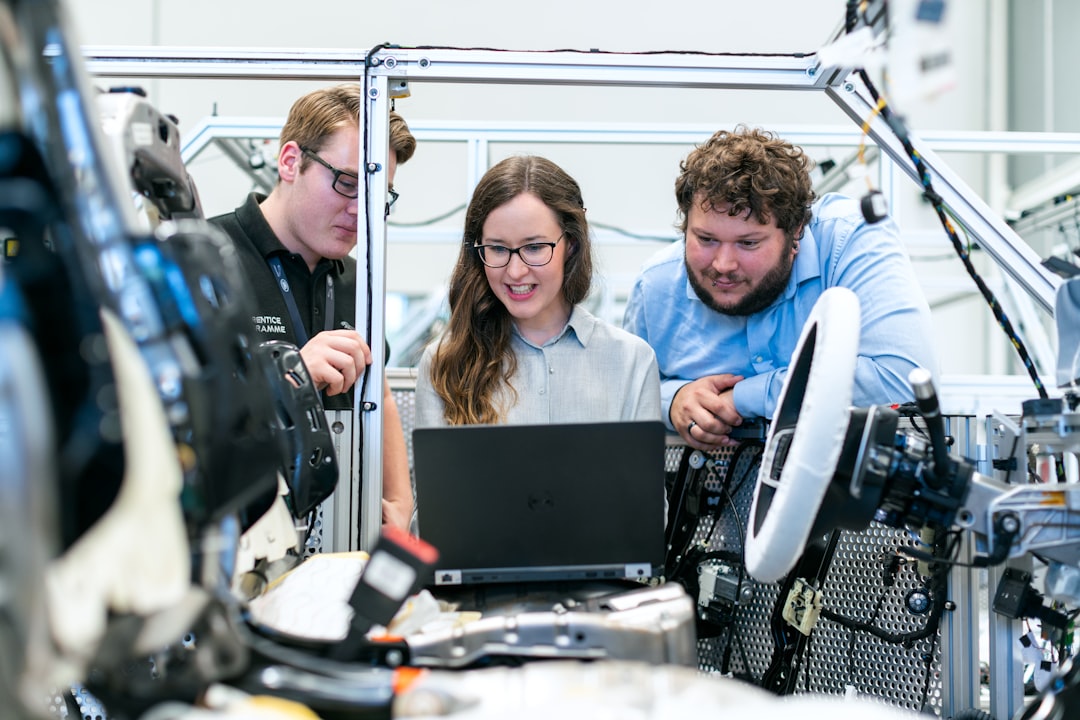

编程语言演进:应对大数据处理的技术复杂性

大数据的技术栈极其复杂,涉及数据采集、存储、计算、分析和可视化等多个环节。选择合适的编程语言对于构建高效、可维护的大数据应用至关重要。

Python:数据分析与机器学习的主流

Python凭借其简洁的语法、丰富的库生态(如Pandas, NumPy, Scikit-learn, PyTorch/TensorFlow)和强大的社区支持,已成为数据科学和机器学习的事实标准。它非常适合进行数据探索、原型开发和模型训练。

# 使用Pandas进行简单的数据聚合分析

import pandas as pd

# 读取数据

df = pd.read_csv('sales_data.csv')

# 按产品类别分组并计算总销售额

sales_summary = df.groupby('product_category')['sales_amount'].sum().reset_index()

# 找出销售额最高的类别

top_category = sales_summary.loc[sales_summary['sales_amount'].idxmax()]

print(f"Top category: {top_category['product_category']}, Sales: {top_category['sales_amount']}")Scala/Java:大规模分布式处理的基石

Apache Spark,这个主流的大数据处理引擎,其核心是用Scala编写的,并提供了优秀的Java和Python API。Scala和Java在JVM上运行,拥有出色的性能和并发处理能力,是构建高吞吐量、低延迟的批流一体数据处理管道的首选。

Go/Rust:云原生与高性能数据服务的新星

随着大数据架构向云原生和微服务演进,Go和Rust这类现代系统级语言崭露头角。Go以高效的并发模型(goroutine)和简洁的语法,非常适合编写数据采集、API服务和分布式协调组件。Rust则以其无与伦比的内存安全性和零成本抽象,在对性能和安全有极致要求的数据处理核心引擎中发挥作用。

// 使用Go并发快速处理多个数据文件

package main

import (

"encoding/csv"

"fmt"

"os"

"sync"

)

func processFile(filename string, wg *sync.WaitGroup) {

defer wg.Done()

file, _ := os.Open(filename)

reader := csv.NewReader(file)

records, _ := reader.ReadAll()

fmt.Printf("File %s has %d records\n", filename, len(records))

// ... 实际处理逻辑

}

func main() {

var wg sync.WaitGroup

files := []string{"data1.csv", "data2.csv", "data3.csv"}

for _, f := range files {

wg.Add(1)

go processFile(f, &wg) // 并发处理

}

wg.Wait()

fmt.Println("All files processed.")

}SQL:历久弥新的数据查询语言

无论技术如何变迁,SQL作为与数据对话的核心语言,其地位从未动摇。现代大数据系统(如Hive, Spark SQL, Presto)都提供了SQL接口,让分析师和开发者能够以声明式的方式高效操作海量数据。

总结:融合创新,迈向可信数据智能未来

大数据应用市场正处于一个关键的十字路口。机遇在于对数据价值的深度挖掘,而挑战则根植于数据治理的深水区。单纯依靠传统的中心化技术和工具已难以破局。

区块链技术的引入,为解决数据共享中的信任、安全和激励问题提供了全新的范式,它正在从底层重塑数据生产关系。另一方面,编程语言的多元化和专业化发展,则为处理日益复杂的数据工程和算法任务提供了更强大、更高效的工具集,从应用层提升了数据生产力的上限。

未来,成功的大数据应用将不再是单一技术的胜利,而是区块链带来的可信基础、多元编程语言构建的高效系统与先进数据分析算法三者的深度融合。只有通过这种融合创新,我们才能在充分保障个人隐私和数据主权的前提下,打破孤岛,释放数据的巨大潜能,真正步入一个安全、可信、智能的数据驱动新时代。