从手忙脚乱到从容不迫:我们如何用Kubernetes搞定一次真实的项目发布?

坦白讲,您是不是也遇到过这种情况?团队好不容易开发完一个Android应用的后端服务,准备上线了,结果发现服务器环境配置起来麻烦得要命,各个服务之间的依赖像一团乱麻。今天这台机器内存不够了,明天那台机器上的Apache服务又莫名其妙挂了,运维同事忙得脚不沾地,开发同事还得等着部署环境才能联调。说实话,这种场景我们见得太多了,简直就是技术团队的“至暗时刻”。

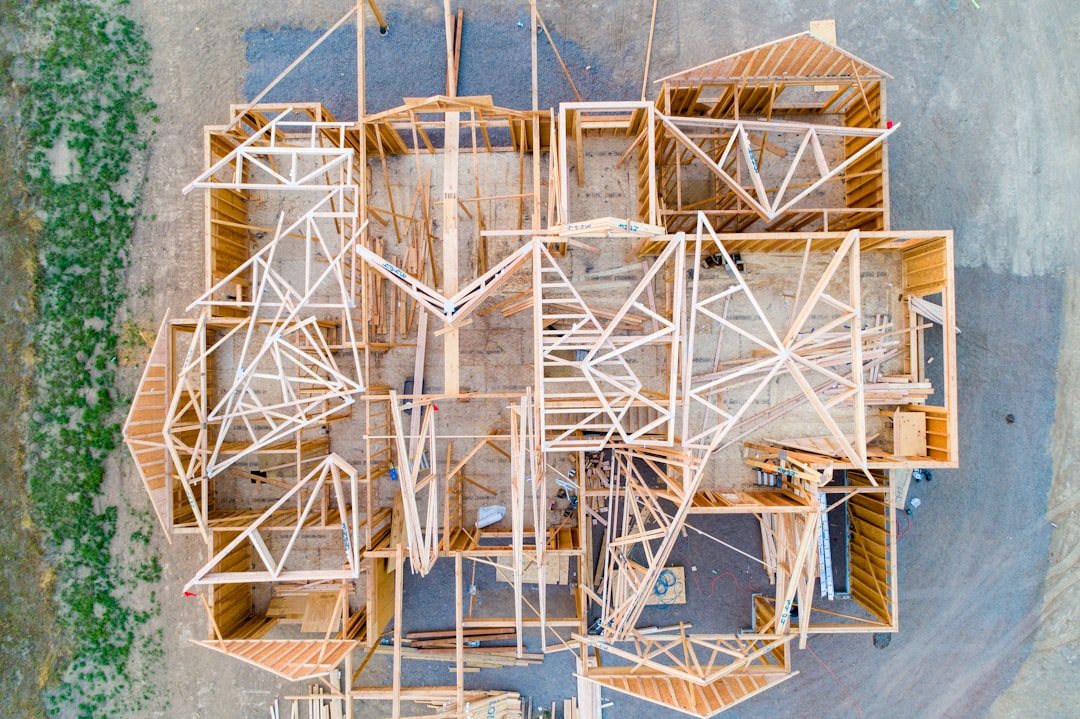

今天,我就想跟您聊聊我们团队的一次真实经历。当时我们接手了一个项目,需要为一个用户量百万级的Android应用搭建一套稳定、可扩展的后端API集群。传统的部署方式让我们吃尽了苦头,直到我们下定决心,把整个服务迁移到Kubernetes上。这个过程,就像给混乱的交通系统装上了一个智能调度中心,一切都变得井井有条。

为什么是Kubernetes?我们的“血泪史”与顿悟

在决定用Kubernetes之前,我们其实走了不少弯路。最开始,我们就是按照最传统的Apache教程,在几台虚拟机上手动安装配置Web服务器、负载均衡和数据库。每次更新Android开发教程里提到的后端API接口,都是一次“深夜惊魂”:手动替换文件、重启服务,还得祈祷别影响到正在使用的用户。

问题很快就暴露了。有一次做促销活动,用户量瞬间暴涨,我们的服务因为无法快速扩容,直接宕机了半个小时!团队所有人都被叫起来紧急处理,那场面别提多狼狈了。从那次以后,我们就明白,靠人工运维和固定的虚拟机,根本应对不了业务的波动。

Kubernetes对我们来说,就像一个“救星”。它能把我们的应用服务打包成一个个独立的集装箱(容器),然后由一个智能大脑(Master节点)来统一调度和管理。哪台机器(Node节点)资源有空闲,就把集装箱放上去运行;哪个服务访问量大了,就自动多启动几个集装箱来分摊压力。这不正是我们梦寐以求的弹性能力吗?

实战搭建:我们踩过的坑和填坑秘诀

道理都懂,但真正动手搭建一个生产可用的Kubernetes集群,可不是看几篇教程就能搞定的。我们当时的目标很明确:搭建一个高可用的集群,能承载我们的核心API服务。

集群规划与搭建:稳字当头

我们选择了三台机器作为Master节点,避免单点故障。这里有个小秘诀:etcd集群一定要分开部署,或者用外部etcd。我们一开始图省事,把etcd和Master组件放在一起,结果有一次网络波动,整个集群的控制面都差点儿挂了,教训深刻。

安装过程我们主要用了kubeadm,它算是官方推荐的“快速安装工具”。但您千万别以为点几下就完了,有几个配置文件必须根据您的实际情况仔细调整:

- 网络插件:我们选了Calico,因为它对网络策略支持得好,性能也不错。想象一下,您能精确控制哪个API服务能访问数据库,这安全感一下子就上来了。

- 镜像仓库:我们自建了一个私有的Harbor仓库。把所有服务的Docker镜像都推送到这里,集群再从这儿拉取,速度又快又安全。

- 存储方案:考虑到我们的服务有状态数据(比如用户上传的图片),我们提前部署了NFS作为共享存储,并通过StorageClass提供动态存储卷。

把应用“搬”上去:从Apache到Pod的转变

集群搭好了,接下来就是把我们原来的服务迁移上去。以前我们是在虚拟机上直接配置Apache来跑PHP应用,现在得把它们容器化。

我们为每个后端模块编写了Dockerfile,把它们打包成镜像。然后,最关键的一步来了:写Kubernetes的部署文件(Deployment YAML)。这里我们特别注重了以下几点:

- 资源限制:给每个Pod都设置了CPU和内存的请求(requests)和上限(limits)。这就好比给每个租客(Pod)规定了用水用电量,防止某个服务发疯把整栋楼(Node)的资源都吃光。

- 健康检查:配置了存活探针(Liveness Probe)和就绪探针(Readiness Probe)。这样Kubernetes就能自动判断服务是不是真的健康,不健康的会自动重启,没准备好的不会接收流量,大大提升了系统的自愈能力。

- 配置分离:把数据库连接地址、API密钥这些配置都抽出来,放到ConfigMap和Secret里。以后要修改配置,再也不用重新构建镜像了,直接改一下配置对象,滚动更新就行!

效果立竿见影:我们的业务发生了哪些变化?

当所有服务都平稳运行在Kubernetes集群上之后,变化真的是肉眼可见。我给您举几个最实在的例子:

第一,发布再也不用“熬夜”了。 以前发布新版本的Android开发教程配套API,得定在半夜,通知所有人,手动操作,心惊胆战。现在呢?我们只需要更新一下Deployment的镜像版本,Kubernetes会自动执行“滚动更新”,一点点用新Pod替换掉旧的,服务全程不中断!发布变成了一个常规的、白天的操作。

第二,应对流量高峰,从容不迫。 我们又做了一次促销活动。这次,我们提前配置好了HPA(水平Pod自动扩缩容)。当监控发现API服务的CPU使用率超过70%时,Kubernetes在几分钟内就把Pod数量从5个自动增加到了12个,稳稳地扛住了流量。活动结束,流量下降,它又自动缩容回去,省资源!

第三,故障自愈,运维压力骤减。 有一次,一台底层物理机突然故障。放在以前,那台机器上跑的所有服务全得瘫痪,报警电话能被打爆。但现在,Kubernetes在几十秒内就检测到Node失联,立刻把它上面所有Pod都调度到其他健康的机器上重新启动。业务影响微乎其微,运维同事甚至是从容地吃完早饭才开始排查硬件问题。

给您的真诚建议:这条路值得走

回顾整个项目,从最初被运维问题搞得焦头烂额,到如今坐在监控大屏前气定神闲,Kubernetes带给我们的不仅仅是技术的升级,更是研发运维理念的革新。它把我们从繁琐、重复、易错的手工操作中解放出来,让我们能更专注于业务逻辑和Android开发教程本身的内容创新。

当然,学习曲线是有的,初期也会遇到各种报错和坑。但我想说,这条路绝对值得投入。尤其是对于业务在增长、服务在变复杂的团队来说,越早拥抱容器化和Kubernetes,就越早能建立起技术的护城河。

如果您也想告别部署的混乱,让您的服务像我们一样拥有弹性、高可用的超能力,那么从今天开始,规划您的Kubernetes之旅吧!从一个简单的测试集群开始,迁移一两个非核心服务试试水,您很快就会感受到它带来的巨大价值。有什么问题,也欢迎随时交流,咱们一起把这条路走通、走顺!