在线课程推荐:踩坑经历与避坑指南

在技术日新月异的今天,持续学习是开发者保持竞争力的不二法门。在线课程平台为我们提供了海量的学习资源,从基础的编程语言到前沿的AI技术,应有尽有。然而,面对琳琅满目的课程,如何选择一门高质量的、真正能学到东西的课程,却是一门学问。许多开发者,包括笔者自己,都曾有过投入大量时间和金钱,最终却收获寥寥的“踩坑”经历。本文将从开发者最关心的两个技术点——代码编辑器配置与AI技术趋势——出发,结合亲身经历,分享如何甄别优质课程,并提供一份实用的“避坑指南”。

第一节:代码编辑器配置课程——从“能用”到“高效”的鸿沟

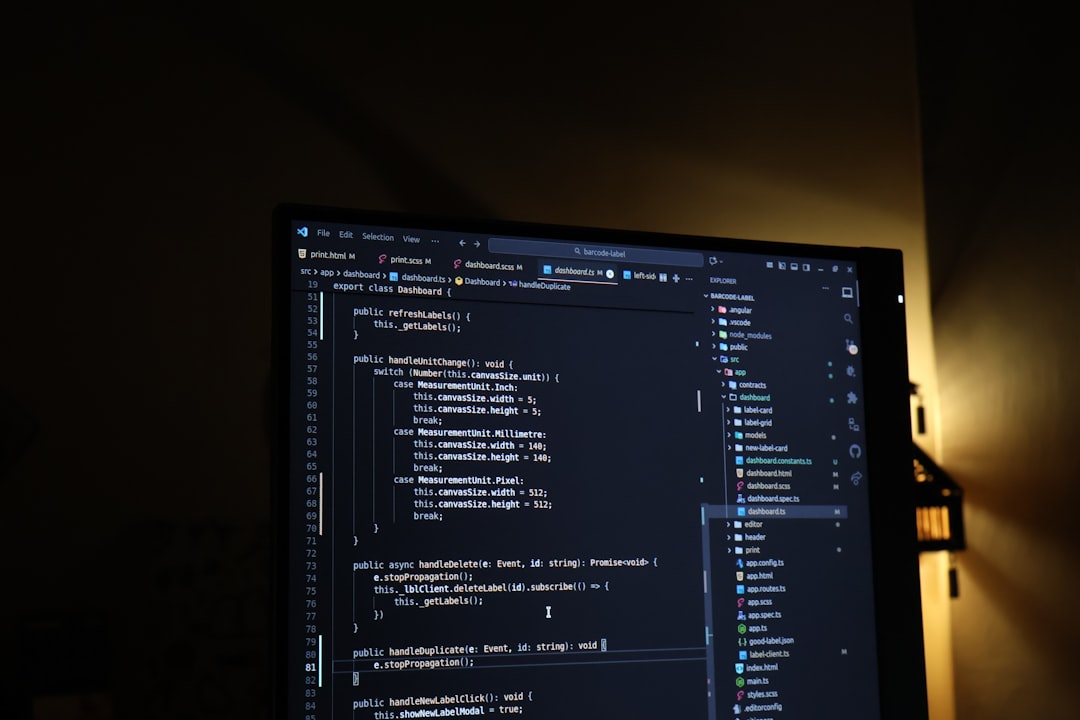

几乎所有编程入门课程都会教你安装一个代码编辑器,比如 VS Code。但绝大多数课程止步于“安装完成,可以写代码了”。这就像只给了你一把没开刃的剑。真正提升开发效率的,是深度定制和熟练使用编辑器的各种功能。

踩坑经历: 我曾报名一门价格不菲的“全栈开发”课程。在环境搭建环节,讲师只用5分钟演示了VS Code的安装,并简单提了一句“大家可以安装一些插件”。至于装什么插件、如何配置快捷键、如何集成终端和调试工具,一概没有。结果在后续复杂的项目开发中,我和许多同学都陷入了效率低下的泥潭,大量时间浪费在手动格式化和文件查找上。

避坑指南与优质课程特征:

- 看课程大纲是否包含“开发环境优化”或“生产力工具”独立章节。 一门负责任的进阶课程,应该专门讲解如何将编辑器打造成开发利器。

- 关注是否讲解核心插件及其配置。 例如,对于前端开发,课程是否涉及:

- ESLint/Prettier: 如何实现保存自动格式化与代码检查。

- GitLens: 如何可视化代码历史。

- Live Server: 如何配置热重载。

- 远程开发: 如何配置 SSH 连接容器或服务器进行开发。

- 检查是否有实际的配置文件分享。 讲师应该提供自己的

settings.json和keybindings.json文件,并解释关键配置项的作用。

技术细节示例: 一个优质的课程会教你如何配置 VS Code 的 settings.json 来实现保存时自动修复和格式化:

{

"editor.formatOnSave": true,

"editor.codeActionsOnSave": {

"source.fixAll.eslint": true

},

"[javascript]": {

"editor.defaultFormatter": "esbenp.prettier-vscode"

},

"eslint.validate": [

"javascript",

"javascriptreact",

"typescript",

"typescriptreact"

]

}并解释formatOnSave与codeActionsOnSave的区别,以及如何为不同语言指定不同的格式化工具。

第二节:AI技术趋势课程——警惕过时理论与空洞概述

AI领域,特别是深度学习和大语言模型(LLM),发展速度极快。去年还流行的模型和工具,今年可能已被淘汰。因此,AI课程的“保鲜期”非常短。

踩坑经历: 我在2022年底购买了一门“人工智能实战”课程,其核心内容还停留在TensorFlow 1.x的静态图模式和一些经典的CNN模型。而当时行业早已转向PyTorch和Transformer架构。课程中的代码示例无法在新版本库中运行,讲师对BERT之后的模型进展几乎未提。这门课程的知识严重滞后于市场,学习价值大打折扣。

避坑指南与优质课程特征:

- 核查课程更新时间与内容版本。 优先选择近6个月内更新过的课程。检查课程中使用的框架(如PyTorch、TensorFlow)和模型(如GPT、Llama、Stable Diffusion)是否是当前主流版本。

- 区分“概念科普”与“实战深入”。 如果你想真正上手,应选择包含大量代码、数据集和实验的课程。课程大纲应包含“数据准备”、“模型训练/微调”、“评估与部署”等完整链路。

- 关注讲师是否涉及“AI工程化”内容。 真正的趋势不仅是模型本身,更是如何应用。优质课程会讲:

- 如何使用 LangChain、LlamaIndex 等框架构建AI应用。

- 如何对开源大模型(如Llama 3)进行量化、微调(LoRA)。

- 如何通过Prompt Engineering和RAG(检索增强生成)优化模型输出。

技术细节示例: 一门紧跟趋势的课程会演示如何使用 PyTorch 和 Hugging Face Transformers 库快速微调一个文本分类模型,而不是从零开始构建网络:

from transformers import AutoTokenizer, AutoModelForSequenceClassification, Trainer, TrainingArguments

import torch

# 加载预训练模型和分词器

model_name = "bert-base-uncased"

tokenizer = AutoTokenizer.from_pretrained(model_name)

model = AutoModelForSequenceClassification.from_pretrained(model_name, num_labels=2)

# 准备数据集(假设 `encodings` 和 `labels` 已准备好)

# ...

# 定义训练参数

training_args = TrainingArguments(

output_dir='./results',

num_train_epochs=3,

per_device_train_batch_size=16,

evaluation_strategy="epoch",

save_strategy="epoch",

)

trainer = Trainer(

model=model,

args=training_args,

train_dataset=train_dataset,

eval_dataset=eval_dataset,

)

trainer.train()并解释预训练模型(Pretrained Model)、微调(Fine-tuning)和迁移学习(Transfer Learning)在现代AI开发中的核心地位。

第三节:通用选课法则——如何评估任何一门技术课程

除了针对特定技术领域的判断,一些通用的评估标准能帮你过滤掉大部分劣质课程。

- 1. 详看课程评价与问答区: 不要只看五星好评,重点看中、差评和讲师的回复。问答区是否活跃?讲师是否及时、专业地解答问题?这是判断课程售后和支持力度的关键。

- 2. 试看前言和项目演示章节: 前言能看出讲师的授课逻辑和课程设计思路。项目演示则直接展示了课程的最终产出是否具有实用价值和复杂度。警惕那些项目只是“玩具Demo”或界面过时的课程。

- 3. 考察讲师的“实战背景”: 讲师是来自一线大厂的在职工程师,还是纯粹的“教育者”?拥有实战经验的讲师更可能分享书本上没有的“坑”和最佳实践。查看讲师的GitHub、技术博客或LinkedIn资料。

- 4. 对比课程提供的“物料”: 优质课程通常提供清晰的代码仓库(GitHub)、详细的文档、一键环境配置脚本(如Dockerfile)和丰富的课后练习。这些是课程质量的硬指标。

- 5. 明确学习目标: 你是想快速入门了解概念,还是想深入掌握寻求跳槽?前者可以选择相对概览性的课程,后者则必须选择有深度、有完整项目、技术栈符合当前市场需求的课程。

总结

选择在线技术课程,本质上是一次投资。避免踩坑的关键在于保持批判性思维,做足课前调研。对于像代码编辑器配置这类提升底层效率的技能,要选择那些愿意在“磨刀”上下功夫、分享具体配置和工作流的课程。对于AI技术趋势这类飞速发展的领域,则必须将“时效性”和“实战性”作为最高筛选标准,紧盯课程内容是否与当前行业实践同步。

最后,记住课程只是领路人。真正的成长来自于将课程知识应用于个人项目,在解决真实问题的过程中加深理解,并持续关注官方文档、技术社区和行业会议。祝你在学习的道路上,既能避开深坑,也能高效地攀登技术高峰。